学位:工学博士学位

性别:男

毕业院校:北京航空航天大学

学历:博士研究生毕业

在职信息:在职

所在单位:计算机学院(软件学院)

电子邮箱:

细粒度图像识别(FGIR)旨在区分视觉上极为相似的子类别(如不同种类的鸟、汽车或菜品),这通常需要耗费极高的人工标注成本与专家知识 。近年来,以 CLIP 为代表的视觉语言模型(VLMs)通过零样本学习展现出了强大的潜力,大幅缓解了对大规模标注数据的依赖 。

然而,面对细粒度场景时,VLMs 捕捉微小类间差异的能力依然受限 。现有的提示微调(Prompt Tuning)方法大多将类别标签视为“孤立且离散”的实体,完全忽略了类别之间丰富的语义拓扑关系 。这种过度简化的假设导致模型无法有效捕捉层次化依赖和类间相关性,而这恰恰是区分视觉相似类别的核心关键 。

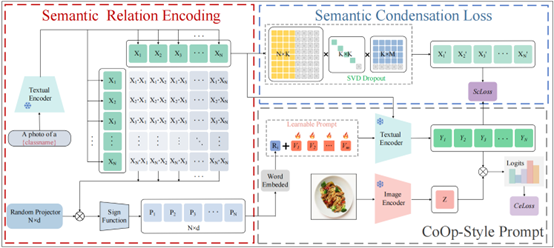

为了打破这一瓶颈,团队提出了 结构化-浓缩提示微调 (SCPT) 方法,将结构感知语义对齐机制引入 CoOp 风格的提示微调框架中 。该框架包含两大核心组件:

语义关系编码 (SRE - Semantic Relation Encoding): SRE 通过随机投影和成对特征交互,显式地对类间语义拓扑结构进行建模 。它利用成对关系距离保留了全局语义结构,让模型真正理解类别之间的层次依赖与相关性 。

语义浓缩损失 (ScLoss - Semantic Condensation Loss): ScLoss 利用奇异值分解 (SVD) 截断和低秩近似,有效抑制了冗余的监督信号和类内噪声,从全局语义空间中精准提取出对分类最具判别力的特征成分 。

在多达 14 个多样化的细粒度基准数据集(涵盖动物、植物、交通工具、食物等)上进行了详尽的实验评估 。

小样本学习 (Few-shot Learning): 在 16-shot 设置下,SCPT 取得了 76.70% 的平均准确率,全面超越了现有的先进提示微调方法 。

基础到新颖类别泛化 (Base-to-Novel Generalization): SCPT 在兼顾基础类别准确率的同时,大幅提升了对新类别的泛化能力,在 14 个数据集上的调和平均准确率 (Harmonic Mean) 达到 71.15%,显著优于现有 SOTA 模型 。

计算效率: SCPT 保持了轻量级的设计,其可学习参数仅占模型总容量的 0.77%,但训练速度比同类方法快 20 倍以上 。